Sarah Dean

UC Berkeley

21 februarie 2020

Învățarea automată oferă o cale promițătoare pentru a distila informațiile de la senzori de dimensiuni mari, cum ar fi camerele foto — un fapt care servește adesea drept motivație pentru îmbinarea învățării cu controlul. Această discuție își propune să ofere garanții riguroase pentru sistemele cu astfel de componente de percepție învățate în buclă închisă. Abordarea noastră constă în caracterizarea incertitudinii în percepție și apoi proiectarea unui controler robust care să țină seama de aceste erori. Folosim un cadru care tratează incertitudinile într-un mod explicit, permițându-ne să oferim garanții de performanță și să ilustrăm modul în care compromisurile apar din limitările datelor de instruire. Pe tot parcursul, voi motiva această lucrare cu exemplul vehiculelor autonome, incluzând atât experimente simulate, cât și o implementare pe o mașină autonomă la scară 1/10. Lucru în comun cu Aurelia Guy, Nikolai Matni, Ben Recht, Rohan Sinha și Vickie Ye.

Vezi playlistul complet:

0:00 Introducere

0:12 Control sigur și robust bazat pe percepție

0:46 Învățarea automată este un instrument promițător pentru

1:20 acționând pe baza unor informații complexe

3:20 Exemplu: Curse din pixeli

5:38 Sarcini modelate ca probleme de control optim

6:36 Problemă de control optim bazată pe percepție

8:26 Percepție ca senzor virtual

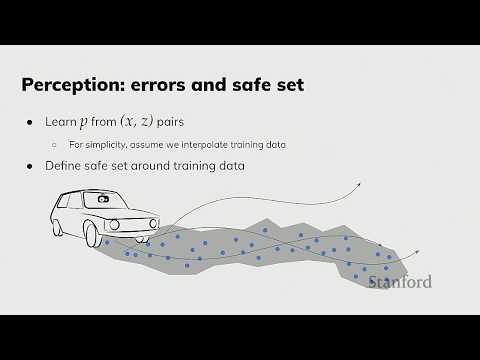

9:28 Setarea problemei: control liniar optim • Dinamica liniară • Model de observare complex • Harta percepției pentru virtual

10:22 Control liniar de feedback de ieșire Setare familiară

11:05 Deoparte, controlul la nivel scăzut

13:27 Percepție: erori și set sigur

14:15 Învățare și generalizare

17:32 Generalizare deterministă (adversarială) • Stările în buclă închisă depind de erori

19:02 Apropierea implică generalizare

20:35 Control puternic

22:07 Sinteză la nivel de sistem pentru feedback de stare

23:56 Reformulare optimă a controlului

29:11 Paradigma pentru analiza învățării în control

31:06 Feedback de ieșire SLS

34:37 Exemplu: filtru static și feedback de stare În cazul unui controler al formularului

38:47 Urmărire robustă a referințelor Modele puncte de referință sau perturbări

40:23 Exemplu: necesar și suficient Pentru un exemplu simplu de integrator dublu cu control LOG, constrângerea este necesară și suficientă pentru stabilitatea la origine

41:12 Setare simulare Exemplu simplificat de conducere folosind simulatorul CARLA cu dinamică 2D dublu integrator

42:40 Rezultate simulare

44:45 Demo din lumea reală

44:55 Curse iterative pe piste arbitrare

49:35 Concluzie

Cursuri interesante:

- Seminar Stanford – Manipulare robotică adaptabilă folosind senzori tactili

- Seminar Stanford – Fundamentele percepției spațiale pentru robotică

- Seminar Stanford – Provocări în siguranța AI: o perspectivă de la o companie de conducere autonomă

- Stanford CS229: Curs de învățare automată, curs 1 – Andrew Ng (toamna 2018)

- 25. Ciclul de levier și criza ipotecarelor subprime

- Seminar Stanford – Autonomie robotică bogată în percepție cu modele de mediu neuronal

- Seminar Stanford – Sisteme pentru sprijinirea formării intențiilor și a comunicării om-AI

- A percepe înseamnă a crede: Psihologie curs intensiv #7

- Curs 2. Automat programabil cu LCD. Programare vizuala. Citire Modbus si afisare pe LCD si Dasboard.

- Seminar Stanford – Prognoza și alinierea IA, Jacob Steinhardt